Docker部署ollama搭建qwen

cd /etc/yum.repos.d/

mkdir -p /centos.repo.bak

mv * /centos.repo.bak/

sudo curl -o /etc/yum.repos.d/docker-ce.repo

https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

curl -o Centos-Base-aliyun.repo https://mirrors.aliyun.com/repo/Centos-7.repo

#B.epel.repo

curl -o epel-7-aliyun.repo https://mirrors.aliyun.com/repo/epel-7.repo

sudo yum clean all

sudo yum makecache

# 防火墙

systemctl stop firewalld && systemctl disable firewalld && sed -i "s?enfofcoing=?disabled?" /etc/selinux/config && setenforce 0 && systemctl status firewalld

# 如果安装过旧版本,则需卸载已安装的旧版本。反之,此步骤可以略过

yum remove docker docker-common docker-selinux docker-engine

# 安装依赖

yum install -y yum-utils device-mapper-persistent-data lvm2

yum install docker-ce docker-ce-cli containerd.io -y

systemctl start docker && systemclt enble docker && docker status docker

echo "查看进程" && ps -ef | grep docker && docker version

vi /etc/docker/daemon.json

{

"registry-mirrors": [

"https://c7s5k5vw.mirror.aliyuncs.com",

"https://dockerpull.org",

"https://docker.unsee.tech/",

"https://docker.1panel.live/",

"https://docker.udayun.com/",

"https://docker.nastool.de/"],

"dns": ["8.8.8.8","114.114.114.114","223.5.5.5"]

}

systemctl daemon-reload && systemctl restart docker && systemctl status docker

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

---------------------------------------错误 ----------------------------------------------

#提示 Error: No such container

docker stop b486203540da # 替换为你的容器ID前几位

docker rm b486203540da

docker run -d -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

------------------------------------------------------------------------------------------

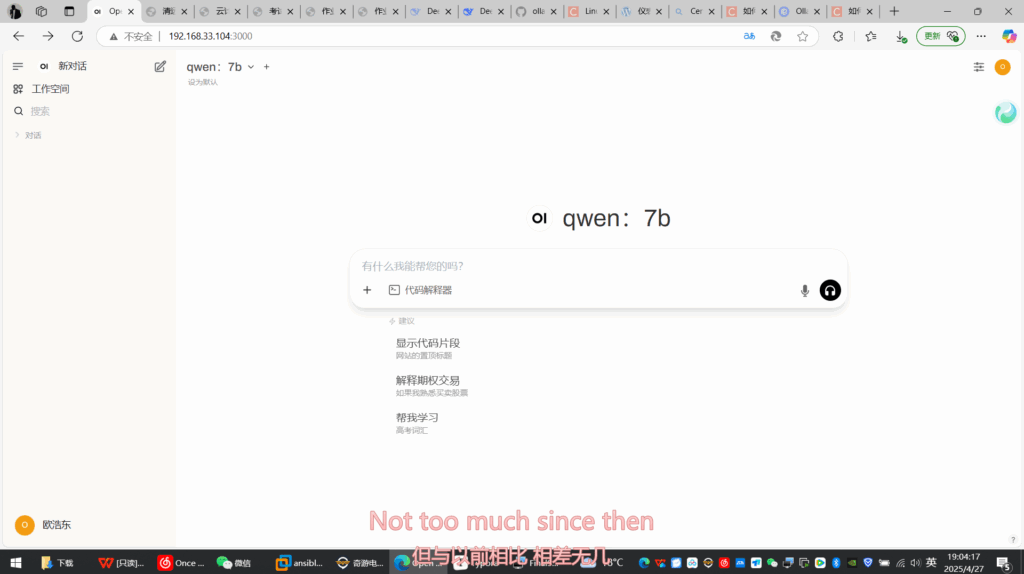

docker exec -it ollama ollama pull qwen:7b

docker exec -it ollama ollama run qwen:7b

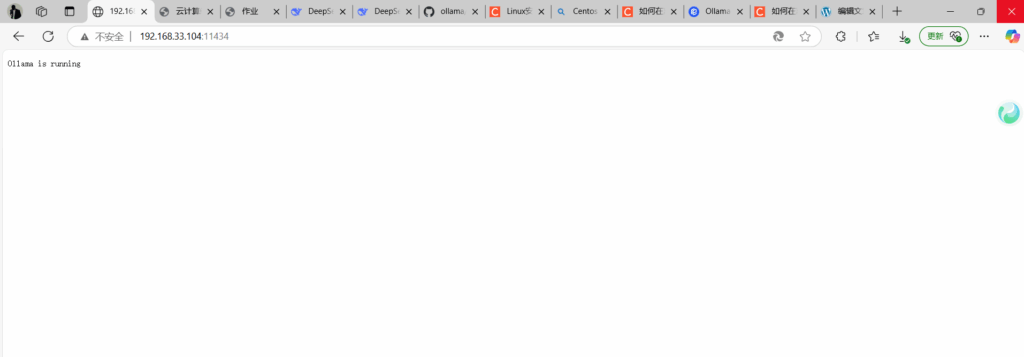

访问网页:localhost:11434

安装WebUI

docker run -d -p 3000:8080

-e OLLAMA_BASE_URL=http://host.docker.internal:11434

-v open-webui:/app/backend/data

--name webui

--restart always

ghcr.io/open-webui/open-webui:main

访问 http://<你的服务器IP>:3000,注册账号后即可使用。

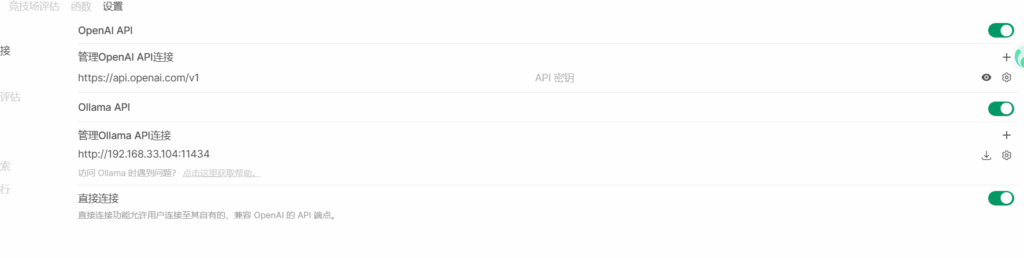

配置模型

登录 Open WebUI。

在设置中选择 Ollama 作为后端。

输入 Ollama 地址:http://host.docker.internal:11434(或 http://localhost:11434)。

选择 qwen:7b 作为默认模型。

https://shorturl.fm/R4FtM